La red social desarrolló algoritmos que logran detectar signos de alarma en publicaciones

El dispositivo enviará el contenido a un equipo humano de revisión, que se pondrá en contacto con el usuario

Es más preciso que el sistema de reportes de alerta que existe

Se anunciaron también nuevas características de seguridad para la modalidad Live del sitio

Martes 7 de marzo de 2017, p. 2

Facebook ha comenzado a utilizar inteligencia artificial (IA) para identificar a usuarios que son suicidas potenciales. La red social ha desarrollado algoritmos capaces de detectar signos de alarma en publicaciones y comentarios. Pueden ser frases como “¿Estás bien?” o “Me preocupas”, o charlas más generales sobre tristeza o dolor.

El dispositivo de IA enviaría tales publicaciones a un equipo humano de revisión, el cual se pondría en contacto con el usuario y ofrecería ayuda, como contactos con servicios de apoyo o una charla con un miembro del personal a través de Facebook Messenger. Anteriormente el sitio se apoyaba en reportes de otros usuarios sobre actualizaciones de estado preocupantes.

“La IA es más precisa que los reportes que recibimos de personas que ponen alertas de suicidio o autoagresión”, declaró a BuzzFeed Vanessa Callison-Burch, gerente de producto de Facebook. “Las personas que han publicado ese contenido (el reportado por la IA) tienen más probabilidades de recibir recursos de apoyo que las que se reportan con nosotros.”

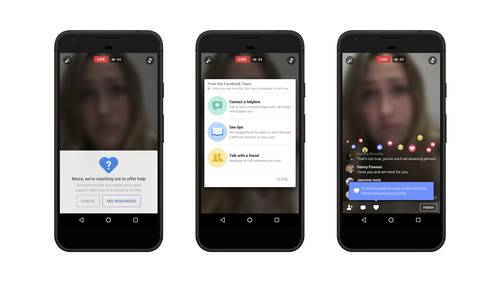

A prueba en EU

El sistema está a prueba en Estados Unidos. El sitio también ha anunciado nuevas características de seguridad para Facebook Live, el cual se ha utilizado para transmitir en vivo varios suicidios. Ahora los usuarios pueden alertar sobre conductas inquitantes en Facebook Live, el cual mostrará un aviso y marcará el video para que el personal de apoyo haga una revisión inmediata. El propósito es brindar ayuda tan rápido como sea posible, durante la transmisión misma y no después.

“Algunos dirían que debemos cortar la transmisión en el momento en que hay un indicio de que se habla de suicidio”, comentó Jennifer Guadagno, jefa de investigación del proyecto. “Pero lo que los expertos han subrayado es que al cortar la transmisión muy pronto se perdería la oportunidad de extender la mano y ofrecer ayuda. Así pues, esto abre las puertas a que amigos o familiares se comuniquen con una persona que sufre, en el momento en que tal vez más lo necesita”.

El presidente de Facebook, Mark Zuckerberg, describió en un comentario reciente los planes de utilizar la IA para identificar contenido preocupante. “Mirando al futuro, una de nuestras mayores oportunidades de dar seguridad a las personas es construir inteligencia artificial para entender con más rapidez y precisión lo que ocurre dentro de nuestra comunidad”, señaló. Una versión anterior del texto indicaba que llevaría “muchos años desarrollar” sistemas de IA capaces de identificar asuntos como los riesgos de acoso y terrorismo en línea, pero esa parte se retiró poco antes de que el manifiesto se publicara.

© The Independent

Traducción: Jorge Anaya